Legge geometrica

| Legge geometrica | |

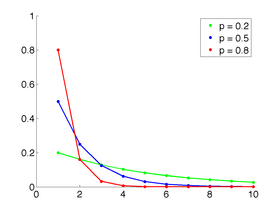

Funzione di massa | |

|

Funzione di distribuzione | |

| impostazioni |

|

|---|---|

| Supporto | |

| Funzione di massa | |

| Funzione di distribuzione | |

| Speranza | |

| Mediano | (non univoco se è intero) |

| Moda | 1 |

| Varianza | |

| Asimmetria | |

| Curtosi normalizzata | |

| Entropia | |

| Funzione generatrice di momenti | |

| Funzione caratteristica | |

| Funzione generatrice di probabilità | |

In teoria e statistica della probabilità , la legge geometrica è una legge di probabilità discreta con due possibili definizioni:

- la legge del numero X dei test di Bernoulli indipendenti con probabilità di successo p ∈] 0.1 [ (oppure q = 1 - p di fallimento) necessaria per ottenere il primo successo. X è la variabile casuale che dà il rango del primo successo. Il supporto della legge è quindi {1, 2, 3, ...}.

- La legge del numero Y = X - 1 fallimenti prima del primo successo. Il supporto della legge è quindi {0, 1, 2, 3, ...}.

I valori di X sono gli interi naturali diversi da zero 1, 2, 3, ... Notando , la probabilità che X = k sia quindi, per k = 1, 2, 3, ...:

Diciamo che X segue una legge geometrica con parametro p .

Calcolo di p ( k )

La probabilità p ( k ) corrisponde alla probabilità di ottenere in una successione di k test di Bernoulli , k - 1 fallimenti seguiti da un successo. Poiché i test sono indipendenti, questa probabilità è q k - 1 p .

Altra definizione

Per la legge geometrica, talvolta incontriamo questa definizione: la probabilità p ' ( k ) è la probabilità, durante una successione di test di Bernoulli indipendenti, di ottenere k fallimenti seguiti da un successo. Modella la durata della vita di un'entità che avrebbe la probabilità p di morire in qualsiasi momento . Otteniamo quindi, per k = 0, 1, 2, ...:

Si noti che questo è solo uno spostamento della legge geometrica precedente, nel seguente senso: se X segue la legge p allora X - 1 segue la legge p ' . La sua speranza allora non è più1p ma di 1p- 1 , vale a direqp. La varianza è la stessa per entrambe le definizioni. Di seguito, prenderemo la prima definizione.

Data di morte, durata della vita

Se chiamiamo p la probabilità di decadimento di una particella radioattiva, la legge geometrica è il primo modello discreto della morte di una particella radioattiva. La durata della particella radioattiva V segue la seguente legge di probabilità:

Per p piccolo, ln (1 - p ) è vicino a - p così

dove troviamo la distribuzione della legge esponenziale .

Aspettativa, varianza, deviazione standard

L' aspettativa di una variabile casuale X che segue una distribuzione geometrica del parametro p è 1 ⁄ p , e la sua varianza èqp 2dove q = 1 - p è la probabilità di fallimento:

La deviazione standard è quindi√ qp.

DimostrazioneCalcoli preliminari: per tutte le x di [0, 1 [ ,

In particolare :

Possiamo quindi utilizzare queste identità per il calcolo dell'aspettativa:

perché q = 1 - p , e per quello della varianza:

la prima uguaglianza sopra derivante dal teorema di König-Huygens .

Ad esempio, per , e la deviazione media .

Collegamenti ad altre leggi

Legame con la legge geometrica troncata

Nei programmi 2011 di Première Scientifique in Francia, che noi chiamiamo la legge geometrica troncato di parametri n e p , la legge della variabile casuale ottenuto limitando il numero di prove di Bernoulli di parametro p a n e notando il rango del primo successo. . Per convenzione, se non si verifica alcun successo durante gli n test, poniamo X = 0 (a volte troviamo per X il numero di fallimenti ottenuti durante gli n test). La probabilità che X = k sia quindi, per k = 1, 2, 3, ..., n :

e per k = 0

Questa legge della probabilità ha per aspettativa: dove q = 1 - p .

Il termine "troncato" qui non ha lo stesso significato di quello che si trova nella definizione di una legge troncata .

Collegamento con la legge esponenziale

La legge geometrica è una versione discretizzata della legge esponenziale. Di conseguenza, la legge esponenziale è un limite delle leggi geometriche rinormalizzate.

Proprietà - Se X segue la legge esponenziale dell'aspettativa 1 e se allora Y segue la legge geometrica del parametro

DimostrazioneSi noti che, per un numero reale x , denota la parte intera superiore di x , definita da

Risultato:Quindi, per ottenere una variabile casuale Y ' secondo una legge geometrica di parametro arbitrario p (con comunque il vincolo 0 < p <1 ), da una variabile casuale esponenziale X' di parametro λ , è sufficiente impostare

dove abbiamo scelto

In effetti, segue una legge esponenziale del parametro 1 (e aspettativa 1).

Reciprocamente,

Proprietà - Se, per la variabile casuale Y n segue la legge geometrica del parametro p n , e se, contemporaneamente,

allora a n Y n converge di diritto verso la legge esponenziale del parametro λ .

DimostrazioneDiamo a noi stessi una variabile casuale esponenziale X con parametro 1 e impostiamo

Quindi Y n e hanno la stessa legge, in virtù della proprietà precedente. Inoltre, per tutti ω

Tuttavia, da un lato, una convergenza quasi sicura porta alla convergenza in legge, dall'altro la legge di X / λ è la legge esponenziale del parametro λ .

Legame con la legge binomiale negativa

Se X n è una variabile casuale distribuita secondo i parametri binomiali negativi n e p , allora X n ha la stessa distribuzione della somma di n variabili casuali indipendenti distribuite in una distribuzione geometrica con parametro p .

Vedi anche

- Variabili casuali elementari

- Radioattività

- Metodo di rigetto

- Processo di Bernoulli

- Legge esponenziale

- Legge binomiale negativa

- Problema del collezionista di vignette (un esempio che mostra una legge geometrica)

Note e riferimenti

- Éduscol documento di risorse - Statistica e probabilità - giugno 2011 , pp. 13-24

- Corso di probabilità 2011/2012 dell'UJF di Grenoble, p. 7

![{\ displaystyle p \ in [0,1]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/33c3a52aa7b2d00227e85c641cca67e85583c43c)

![{\ displaystyle \ mathbb {E} [X] = {\ frac {1} {p}}, \ qquad \ mathbb {V} [X] = {\ frac {1-p} {p ^ {2}}} = {\ frac {q} {p ^ {2}}}.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/1c45470c0681d6ec6b01db8ce5b8ef609060a565)

![{\ displaystyle {\ begin {align} \ mathrm {Var} (X) & = \ left (\ sum _ {k = 1} ^ {+ \ infty} k ^ {2} q ^ {k-1} p \ destra) - \ mathbb {E} [\ mathrm {X}] ^ {2} \\ & = {\ frac {2p} {(1-q) ^ {3}}} - {\ frac {p} {( 1-q) ^ {2}}} - {\ frac {1} {p ^ {2}}} \\ & = {\ frac {2} {p ^ {2}}} - {\ frac {1} {p}} - {\ frac {1} {p ^ {2}}} \\ & = {\ frac {q} {p ^ {2}}}, \ end {align}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/eb76e40124b938dabc631c1f411d53a947a49c7b)

![{\ displaystyle \ mathbb {E} [X] = 2, \ mathbb {V} [X] = 2, \ sigma [X] = {\ sqrt {2}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/975a1a34c2596ae64c7077b163227ab5e83d5618)

![{\ displaystyle {\ begin {align} \ mathbb {P} (Y = k) & = \ mathbb {P} (\ lceil \ theta X \ rceil = k) \\ & = \ mathbb {P} (\ theta X \ in] k-1, k]) \\ & = \ mathbb {P} \ left (X \ in \ left] {\ tfrac {k-1} {\ theta}}, {\ tfrac {k} {\ theta}} \ right] \ right) \\ & = F_ {X} \ left ({\ tfrac {k} {\ theta}} \ right) -F_ {X} \ left ({\ tfrac {k-1} {\ theta}} \ right) \\ & = \ exp \ left (- \ {\ tfrac {k-1} {\ theta}} \ right) - \ exp \ left (- \ {\ tfrac {k} { \ theta}} \ right) \\ & = \ left (\ mathrm {e} ^ {- \ {\ tfrac {1} {\ theta}}} \ right) ^ {k-1} \ \ left (1- \ mathrm {e} ^ {- \ {\ tfrac {1} {\ theta}}} \ right). \ end {align}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/d26eb9e174de0e7af0a22a85541836596cb4c8ac)